Carl Sagan, scientifique connu pour son scepticisme a décrit dans un ouvrage célèbre la démarche scientifique et les outils de la pensée critique. Il a résumé cela de manière très simple et concise dans son fameux « Kit de détection d’idioties ». Il s’agit d’une liste d’outils permettant de vérifier la solidité d’hypothèses, et d’éviter les erreurs de logiques ou de rhétoriques les plus courantes. Dans ce premier volet, je vous présente les outils pour bien construire et tester un raisonnement.

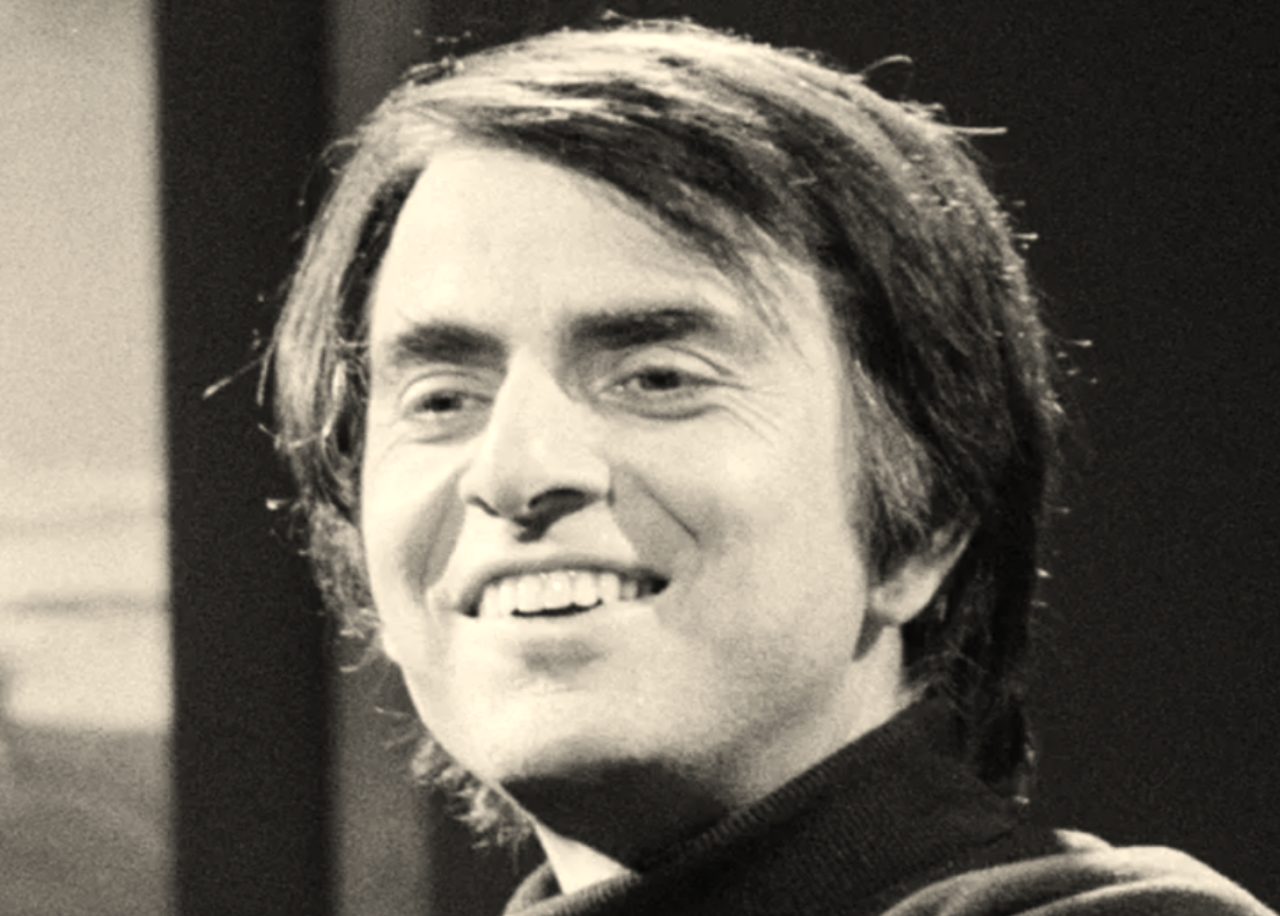

Carl Sagan et le scepticisme

J’avais déjà parlé ici de l’excellent bouquin de Normand Baillargeon : « Petit cours d’auto-défense intellectuelle« . A lire d’urgence, pour tous ceux que le doute et le scepticisme scientifique intéresse plus que la conviction et les raisonnements engagés.

Une bonne partie du contenu de ce livre se trouve en ligne sur le site d’Olivier Hammam.

J’avais découvert, grâce à ce livre, Carl Sagan. Carl Sagan était un astronome. Il est resté célèbre, entre autres, pour son scepticisme.

Je ne résiste pas au plaisir d’une petite citation :

D’un autre côté, si vous êtes ouvert jusqu’à la crédulité et n’avez pas même une once de scepticisme en vous, alors vous n’êtes même plus capable de distinguer entre les idées utiles et celles qui n’ont aucun intérêt. Si toutes les idées ont la même validité, vous êtes perdu : car alors, aucune idée n’a plus de valeur.

Son ouvrage le plus connu est The Demon-Haunted World (Science as a Candle in the Dark). C’est un ouvrage qui explique aux néophytes la méthode scientifique, et encourage tout le monde à apprendre le scepticisme (ou esprit critique).

On y trouve un truc formidable, et c’est pour ça que j’écris cet article : un « kit de détection d’idioties » (en anglais « baloney detection kit »).

Ce kit, disponible en anglais iciOn y trouve un extrait de Sagan, C. 1997, The Demon-Haunted World, Headline Book Publishing, London, pp 196-204, me parait suffisamment utile et intéressant pour que je le republie ici : j’espère que vous y trouverez un intérêt également. En ces temps peu sereins où le principe de précaution devient un guide-âne de l’action à la place de l’envie d’entreprendre et de comprendre, quelques règles simples de pensée ne peuvent pas être inutiles pour éviter de se faire promener par les marchands de peur. La connaissance du monde, qui va forcément avec une place laissée au doute, doit rester notre fil conducteur. Sous peine de voir les passions l’emporter sur la raison. On sait où ça mène.

Kit de détection d’idioties : première partie

Carl Sagan décrit le « kit de détection d’idioties » (appelons le KDI) comme un outil de test des idées nouvelles (dans le domaine scientifique). Si l’idée nouvelle survit au crible du KDI, on lui accorde un certain crédit. C’est une manière de prendre ses précautions, et garder un esprit critique.

Ce que la pensée sceptique apporte, ce sont les moyens de construire et comprendre un raisonnement argumenté, et – chose particulièrement importante – de reconnaitre un argument faux ou frauduleux. La question n’est pas de savoir si nous aimons la conclusion qui émerge d’un raisonnement ou d’une suite d’arguments, mais bien de savoir si la conclusion qui sort de ce raisonnement vient d’une prémisse, et si cette prémisse est vraie.

Carl Sagan

Il y a dans ce kitUn essai passionnant de John D. Nagy (en anglais) sur le « Kit de détection d’idioties » de Sagan se trouve ici deux séries de choses : des outils « positifs » pour évaluer le caractère de connaissance et de véracité de quelque chose, et une liste d’outils « négatifs », de choses à ne pas faire, et pour reconnaitre les erreurs de logique et de rhétorique les plus communes.

Je vous propose de voir ici la liste des outils « positifs », et de voir dans le prochain article la liste de sophismes / paralogismes courants.

Outils du KDI

Voici la liste des outils :

- Lorsque cela est possible, il faut des confirmations indépendantes des faits.

- Il faut encourager des discussions substantielles des faits entre des gens informés ayant différents points de vue.

- Des arguments d’autorité n’ont que peu de poids. Les « autorités » ont fait des erreurs dans le passé. Elles en feront à nouveau dans le futur. Peut-être que la meilleure manière de le dire est qu’en science, il n’y a pas d’autorités ; tout au plus, des experts.

- Envisagez plus d’une hypothèse. S’il y a quelque chose à expliquer, pensez à toutes les manières dont cela pourrait être expliqué. Puis pensez à la manière dont vous pourriez tester, et réfuter les différentes explications. Ce qui reste, les hypothèses qui résistent à la réfutation dans cette sélection Darwinienne parmi des multiples hypothèses de travail, a une meilleure chance d’être la bonne réponse que si vous aviez simplement conservé la première idée qui vous vient à l’esprit.

- Essayez de ne pas vous attacher excessivement à une hypothèse simplement parce que c’est la vôtre. C’est seulement une étape dans la conquête de la connaissance. Demandez-vous pourquoi vous aimez cette idée. Comparez la impartialement à d’autres hypothèses. Voyez si vous pouvez trouver des raisons de la rejeter. Si vous ne le faites pas, les autres le feront.

- Quantifiez. Quelle qu’elle soit, si votre explication comporte des chiffres, des mesures, quelques quantités numériques associées, vous serez mieux à même de faire le tri entre les hypothèses concurrentes. Ce qui est vague et qualitatif est ouvert beaucoup d’explications. Bien sûr, il y a des vérités à chercher dans la quantité d’informations qualitatives que nous examinons, mais elles sont plus difficiles à trouver.

- S’il y a une chaîne d’arguments, chacun des maillons doit fonctionner (y compris la prémisse). Pas seulement la plupart d’entre eux.

- Le rasoir d’Occam : Un principe de base bien utile lorsque l’on est confronté à deux hypothèses qui expliquent aussi bien les faits l’une que l’autre, consiste à choisir la plus simple. La plus simple = l’hypothèse qui repose sur le plus petit nombre de propositions non démontrées.

- Demandez vous si votre hypothèse peut, au moins en principe, être falsifiée (i.e. être démontrée fausse par un test nom ambigu). Les propositions qui sont non-testables, non-falsifiables ne valent pas grand-chose. Imaginez la belle idée que notre univers et tout ce qui existe soit juste une particule élémentaire – disons un électron – dans un Tout encore plus grand. Mais si nous ne pouvons jamais acquérir d’informations depuis l’extérieur de notre univers, est-ce que cette idée n’est pas impossible à réfuter ? Vous devez être capable de vérifier les affirmations. Les sceptiques invétérés doivent avoir une chance de pouvoir suivre votre raisonnement, de refaire vos expériences, et de voir s’ils obtiennent les mêmes résultats.

- S’appuyer sur des expériences soigneusement conçues et contrôlées est la clé. Nous n’apprendrons pas grand-chose de la contemplation. C’est tentant de se reposer sur la première explication qui nous vient à l’esprit (une explication, c’est mieux que rien). Mais que se passe-t-il si nous pouvons en inventer plusieurs ? Comment choisir entre elles ? Nous ne pouvons pas. Nous laissons l’expérience le faire. Francis Bacon a fourni la raison classique :

L’argumentation ne peut pas se contenter de la découverte d’un nouveau travail, car la subtilité de la Nature est bien plus grande que la subtilité des arguments.

- Les expériences de contrôle sont essentielles. Si, par exemple, un nouveau médicament est censé soigner une maladie dans 20% des cas, nous devons nous assurer qu’une population de contrôle, qui prend une bête pillule de sucre (et dont les sujets pensent qu’il s’agit du nouveau médicament), ne guérit pas également dans 20% des cas

- Les variables doivent être séparées. Supposez que vous avez le mal de mer. Et que l’on vous donne un bracelet de Shiatsu et 50mg de meclizine. Votre malaise disparait. Qu’est ce qui l’a fait partir, le bracelet ou la pillule ? Vous ne pouvez le dire que si vous tester l’un sans l’autre, la prochaine fois que vous aurez le mal de mer. Maintenant, imaginez que vous n’êtes pas autant motivé par la science que par l’envie de n’être plus malade. Dans ce cas, vous ne séparerez pas les variables. Vous prendrez les deux remèdes à nouveau. Vous aurez atteint le résultat pratique voulu ; la connaissance future, pourriez-vous dire, ne vaut pas les efforts qu’il faut faire pour l’atteindre.

- Souvent les expériences doivent être faites en « double aveugle », afin que ceux qui espèrent un certain résultat ne soient pas dans la position compromettante d’évaluer ces résultats. Pour tester un nouveau médicament, par exemple, vous pouvez vouloir que les expérimentateurs (qui déterminent quels symptômes des patients sont traités) ne sachent pas quels patients ont pris le nouveau médicament. Cette connaissance pourraient influencer leurs décisions, même si c’est seulement inconsciemment. A la place de cela, la liste de ceux qui ont vu leurs symptômes disparaitre peut être comparée avec la liste de ceux qui ont pris le nouveau médicament, indépendamment établies. Alors vous pourrez déterminer si une corrélation existe. Ou bien encore, dans une séance d’identification de coupables dans une enquête policière, l’officier ne devrait pas savoir qui est le principal suspect, afin de ne pas influencer les témoins.

Et voilà ! J’espère que ça vous a plu. Le prochain article listera les différentes erreurs de rhétoriques ou de logiques auxquelles on peut être confrontés : utile pour contrer les interlocuteurs de mauvaise foi, ou simplement pour éviter les débats stériles…!

Laisser un commentaire